Guerre di Rete - una newsletter di notizie cyber

di Carola Frediani

N.177 - 20 gennaio 2024

Specie per i nuovi, ricordo che questa newsletter (che oggi conta più di 13mila iscritti - ma molti più lettori, essendo pubblicata anche online) è gratuita e del tutto indipendente, non ha mai accettato sponsor o pubblicità, e viene fatta nel mio tempo libero. Se vi piace potete contribuire inoltrandola a possibili interessati, o promuovendola sui social. Molti lettori sono diventati sostenitori facendo una donazione.

In più, il progetto si è ingrandito con un sito indipendente e noprofit di informazione cyber, GuerrediRete.it. Qui spieghiamo il progetto. Qui l’editoriale di lancio del sito.

In questo numero:

Una guida all’AI Watermarking

OpenAI si prepare alle elezioni

Interferenze GPS sul Baltico

I microchips fanno gola all’Europa e all’Italia

E altro

AI WATERMARKING

Una guida al watermarking nell’intelligenza artificiale

Il Brooking Institute ha rilasciato una guida sul watermarking nell’AI.

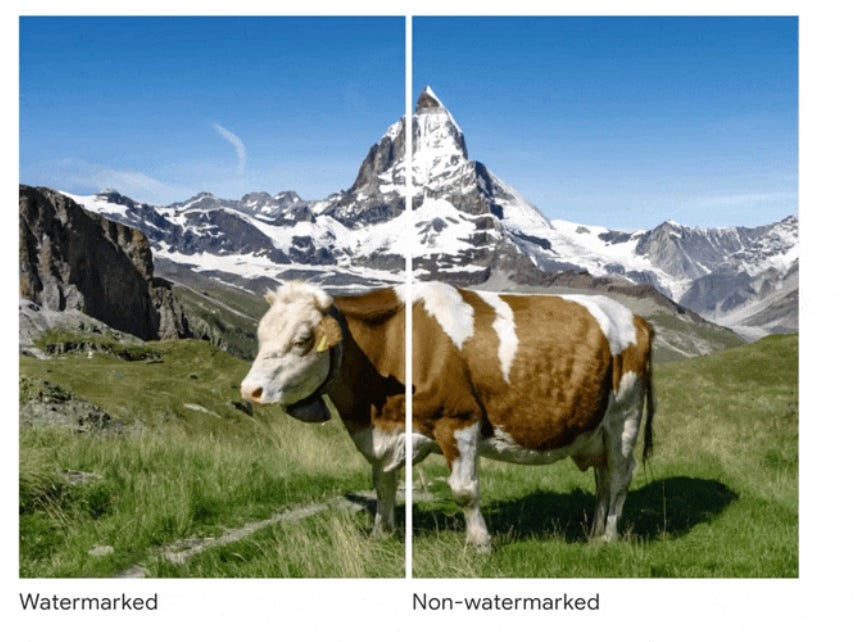

Watermarking è un termine generico che include approcci diversi, ma nel caso specifico le più sofisticate tecniche di watermarking digitale incorporano nei contenuti generati dall'AI degli schemi (patterns) impercettibili che solo i computer possono rilevare.

Rispetto ad altri approcci per identificare i contenuti generati dall'AI, “i watermark sono accurati e più resistenti alla cancellazione e alla contraffazione, ma non sono infallibili: un soggetto motivato può degradare i watermark nei contenuti generati dall'AI”, dice il report.

Inoltre lo sviluppatore di un modello di AI può creare strumenti per rilevare solo il proprio watermark, quindi per l'identificazione efficiente di tutti i contenuti “marchiati” è necessario un coordinamento fra le diverse aziende. Oltre a ciò, ulteriori considerazioni pratiche riguardano le complicazioni con i modelli open-source, le implicazioni sulla privacy e la garanzia di servizi di rilevamento dei watermark affidabili e accessibili. Per questi motivi, un obiettivo realistico è rendere generalmente più difficile aggirare i watermark per i modelli più popolari, dando per scontato che non esistano soluzioni universali o definitive.

La questione è al centro dell’interesse di un po’ tutti i legislatori. L’AI Act europeo, in fase di ultima definizione tecnica dopo il trilogo politico di dicembre, impone ai fornitori e agli utenti di sistemi di AI una serie di obblighi per consentire il rilevamento e la tracciabilità dei contenuti generati da questa tecnologia. “L'attuazione di questi obblighi richiederà probabilmente l'uso di tecniche di watermarking”, scrive in un briefing il Parlamento europeo, altresì consapevole delle attuali limitazioni tecniche, ma comunque orientato a fare sì che lo sviluppo di strumenti di watermarking e di regole standard siano una priorità.

La Cina ha già adottato delle misure per vietare immagini generate dall'AI senza watermarking. Il G7 ha chiesto alle aziende di sviluppare meccanismi di autenticazione e provenienza dei contenuti. L'amministrazione statunitense è stata incaricata di sviluppare meccanismi di etichettatura, in modo che gli utenti finali siano in grado di capire quando un contenuto sia o meno generato dall'AI. Infatti l’ordine esecutivo della Casa Bianca sull'AI ha incaricato il Dipartimento del Commercio di sviluppare standard per identificare l’origine di contenuti ed etichettare quelli sintetici (ne avevo scritto in newsletter). Infine, in occasione del vertice britannico sulla sicurezza dell'AI, sette aziende leader nel settore hanno annunciato delle policy aziendali per identificare materiale generato dall'AI.

Fatte queste premesse, è proprio sulla fattibilità tecnica che si concentra il rapporto. Che individua le metodologie principali.

“I quattro approcci più importanti sono il watermarking (nelle sue varie forme), che consiste nell'incorporare un pattern (schema) identificabile in un contenuto per tracciarne l'origine; la provenienza del contenuto, che incorpora e mantiene in modo sicuro le informazioni sull'origine del contenuto nei suoi metadati; i rilevatori (detector) retrieval-based, in cui tutti i contenuti generati dall'AI sono archiviati in un database che può essere interrogato per verificarne l'origine; e i rilevatori post-hoc, che si basano su modelli di apprendimento automatico per identificare schemi impercettibili ma sistematici nei contenuti generati dall'AI che li distinguono da quelli creati dall'uomo”.

Le complicazioni e le sfide non sono poche. Le tattiche più comuni per ingannare i rilevatori di testo generato dall'AI, ad esempio, includono la parafrasi o la traduzione in una lingua diversa e la successiva conversione nella lingua desiderata. Contro i rilevatori per immagini, le tattiche di evasione più comuni prevedono il ritaglio, sottili alterazioni dei pixel, filtri o sovrapposizioni. In generale, individuare testi generati dall'AI è più difficile rispetto ai contenuti audio-visivi. E particolarmente problematica è l’individuazione di contenuti dove ci sia una componente mista, umana e AI, specie laddove avvenga una “collaborazione” avanti e indietro con un modello.

Tra gli approcci più avanzati di watermarking, ci sono quelli basati sull'apprendimento automatico (machine learning), soprattutto per il watermarking delle immagini. I ricercatori di Meta utilizzano un modello di apprendimento automatico per incorporare un watermarking nascosto basato su una "chiave" che può essere successivamente rilevata da un altro modello di apprendimento automatico. Nei loro esperimenti, la tecnica funziona bene sulle immagini non modificate, ma la precisione diminuisce con le modifiche.

“Il nostro metodo di Stable Signature integra il watermarking nel processo di generazione, senza alcuna modifica all'architettura. Regola il modello generativo pre-addestrato in modo tale da che tutte le immagini prodotte nascondano un determinato watermark”, scrivono gli autori nel paper.

Anche Google ha annunciato uno strumento sperimentale per il watermarking delle immagini (SynthID) che utilizza un modello di apprendimento automatico.

“SynthID utilizza due modelli di deep learning - per il watermarking e l'identificazione - che sono stati addestrati insieme su un set di immagini diverse”, scrive Google. “Il modello combinato è ottimizzato su una serie di obiettivi, tra cui la corretta identificazione del contenuto col watermark e il fatto di rendere quest’ultimo sempre più impercettibile attraverso il suo allineamento visivo al contenuto originale”.

Altra tecnica interessante è il "watermarking statistico", in cui invece di incorporare uno schema (pattern) chiaramente definito nel testo o nel contenuto audio/video, si incorpora una disposizione statisticamente insolita di parole/pixel/suoni. Il problema in questo caso è che si rischia di degradare la qualità del contenuto prodotto. E comunque esistono già ricerche che studiano i modi per cancellare i watermark statistici per i testi.

Le domande che ci dovremmo porre, prosegue il report, sono le seguenti:

- lo strumento di rilevamento dell'AI (proposto) è universale, ossia è in grado di identificare i contenuti generati da qualsiasi AI o solo quelli generati dallo specifico modello di AI corrispondente?

- il metodo (proposto) richiede la collaborazione dello sviluppatore?

- il metodo (proposto) è compatibile con il rilascio di modelli open-source?

- e ha implicazioni sostanziali per la privacy?

- ed è facile fidarsi di questo strumento di rilevamento?

Sfortunatamente - scrive l’autore del report - non esiste uno strumento di rilevamento dell'AI tecnicamente valido che risponda in modo soddisfacente a tutte queste considerazioni.

In conclusione, scrive il report, “un obiettivo ragionevole sarà quello di innalzare la barriera alla generazione di contenuti senza watermarking e di garantire che una frazione significativa di contenuti generati dall'AI incorpori un watermark, pur riconoscendo che il rilevamento di tutti i contenuti generati dall'AI sarà infattibile. Pertanto, gli strumenti di rilevamento dovrebbero essere considerati come parte di un approccio a più livelli e specifico per il contesto”.

ELEZIONI E AI

OpenAI corre ai ripari in vista dell’anno delle elezioni

A questo proposito, ovvero sul tema dell’identificazione di contenuti generati da AI, si muove anche OpenAI, in vista delle elezioni che avverranno nel 2024 in vari Paesi. L’organizzazione ha infatti annunciato che all’inizio di quest’anno implementerà un sistema per aumentare la trasparenza sull’origine e storia delle immagini generate da DALL-E 3, abbracciando una tecnica che codifica i dettagli sulla provenienza dei contenuti attraverso la crittografia (si tratta delle credenziali digitali della Coalition for Content Provenance and Authenticity - C2PA). E di stare testando anche un altro un sistema di identificazione della provenienza (provenance classifier) di immagini per individuare quelle generate da DALL-E.

Inoltre ha fatto sapere che non consentirà alle persone di usare i suoi strumenti per creare applicazioni per campagne politiche e lobbying. E nemmeno di creare chatbot che fingano di essere persone reali (ad esempio, candidati) o istituzioni (come le amministrazioni locali).

E che non permetterà applicazioni che dissuadano le persone dal partecipare ai processi democratici, distorcendo la rappresentazione dei meccanismi elettorali (ad esempio, quando, dove o chi ha diritto di voto) o scoraggiando il voto stesso.

Vedi anche The WashPost.

MERCATO

Cosa vuole ottenere il GPT store di OpenAI

Intanto OpenAI ha lanciato il suo nuovo GPT Store, che consentirà agli utenti business e ChatGPT Plus (la versione a pagamento) di condividere e interagire con agenti AI personalizzati (chiamati GPT), pensati per dei compiti specifici.

Perché questo lancio? Secondo il professore David Karpf su The Atlantic, “il problema per OpenAI è che la maggior parte dei 100 milioni di utenti settimanali di ChatGPT si affidano alla versione gratuita”, con costi vertiginosi per mantenere ChatGPT, a detta del CEO Sam Altman. “A breve termine, più sviluppatori esterni OpenAI sarà in grado di attirare, con più GPT personalizzati per offrire [un po’ di tutto] (…), maggiore sarà la possibilità che gli utenti gratuiti scelgano di iscriversi al servizio a pagamento”.

Sulla stessa linea il commento di Ben Dickson (TechTalks) secondo il quale OpenAI deve vedersela con la crescita dei modelli open-source, che stanno rapidamente guadagnando terreno in qualità, oltre a essere più flessibili e veloci da addestrare. Di qui la necessità di provare a ricostruire un vantaggio infrastrutturale di qualche tipo, ad esempio creando un effetto di rete attorno a ChatGPT. E qui entra in scena il GPT Store.

“L'idea di base è che, con una massa critica sufficiente, gli utenti rimarranno fedeli a ChatGPT e altri utenti si iscriveranno al piano ChatGPT Plus per accedere al GPT Store”, scrive l’autore. Allo stesso modo gli sviluppatori saranno attratti dalla piattaforma, dove i loro assistenti saranno esposti a un maggior numero di utenti.

Intanto il GPT Store contiene già diversi chatbot nelle vesti di “fidanzata AI”, rileva Quartz. Ma questo genere di bot sarebbero contrari alla policy di utilizzo (usage policy) di OpenAI.

LAVORATORI E AI

La protesta del doppiatore di GTA V

Ned Luke, attore e doppiatore di Michael De Santa, uno dei personaggi del noto videogioco Grand Theft Auto V (GTA V), si è scagliato contro WAME, una società di AI generativa, che aveva creato un “chatbot vocale sintetizzando la voce di Luke attraverso GTA V. L'idea era quella di consentire ai fan di GTA di condurre conversazioni in tempo reale con Michael, il personaggio”, scrive Hwupgrade.

Luke ha dunque criticato pubblicamente l'azienda WAME per l'uso senza licenza della sua voce. WAME ha poi cancellato tutti i tweet e il chatbot, scusandosi per l’accaduto, riferisce PCgames.

AI ACT

Riconoscimento facciale meno controllato nella legge europea?

Dopo il trilogo politico di dicembre, che ha portato a un accordo, l’AI Act - il regolamento UE sull’intelligenza artificiale - è nella fase delicata del trilogo tecnico. Dove la messa a terra dei dettagli farà la differenza. Il testo finale ufficiale della legge non c’è ancora, ma una bozza è trapelata sulla testata POLITICO.

Secondo l’analisi (via newsletter) della Ong per i diritti digitali Access Now, tale bozza rivelerebbe ambigui margini di manovra e il rischio che alcune salvaguardie e protezioni dei diritti previsti dalla legge siano annacquati.

“Nella sua forma attuale, permetterebbe alla polizia di utilizzare il riconoscimento facciale per identificare i sospetti nei filmati esistenti senza l'approvazione di un giudice”, scrive l’Ong.

GPS

Finlandia e Svezia segnalano interferenze GPS nel Baltico

Secondo l'Agenzia finlandese per i trasporti e le comunicazioni (Traficom), intorno a Capodanno sono stati osservati dei disturbi nei segnali di navigazione GPS (Global Positioning System) nella Finlandia orientale e sudorientale. Le interruzioni sono state segnalate dal sito GPSjam, che fornisce informazioni sulle interferenze GPS.

Ma cosa vuol dire? “Probabilmente qualcuno sta disturbando (jamming) il GPS - ha twittato John Wiseman, amministratore del sito - In questa zona, di solito si pensa che sia di origine russa. Potrebbe trattarsi di un’attività di disturbo o di un'esercitazione militare. Di solito non è un problema per gli aerei, ma è fastidioso e toglie un livello di sicurezza. Le persone a terra probabilmente non sono nemmeno interessate”.

Traficom ha rassicurato sul fatto che i disturbi del GPS non avrebbero influito sulla sicurezza dei voli, perché gli aerei sono dotati di sistemi di navigazione alternativi, scrive il sito della tv pubblica finlandese Yle.

Un ricercatore noto online con lo pseudonimo di Markus Jonsson sostiene di aver individuato l’origine geografica delle interferenze esaminando i dati dei voli in cui sono stati segnalati problemi GPS, e arrivando a tre possibili località: Kaliningrad, Polonia o Danimarca, riferisce il giornale finlandese Iltalheti. Ricordiamo che Kaliningrad è il nome della città capoluogo dell’omonima oblast’ della Federazione russa, exclave tra la Lituania e la Polonia.

Anche Jukka Savolainen, direttore della rete del Centro europeo di eccellenza per il contrasto alle minacce ibride in Finlandia, ritiene molto probabile che dietro le interferenze ci sia la Russia, riferisce il sito della tv pubblica estone.

L’attività è continuata a gennaio, riporta la tv pubblica svedese SVT. “Tra il 18 e il 26 dicembre, abbiamo ricevuto un totale di circa cinque segnalazioni”, ha affermato Johan Westin, ispettore di volo dell'Agenzia svedese dei trasporti. I disturbi si sono verificati soprattutto di notte nella Svezia meridionale e nel Mar Baltico sudorientale.

Il Servizio di sicurezza e intelligence militare Must svedese sta analizzando gli incidenti, iniziati in concomitanza con l'annuncio di un'esercitazione da parte della Marina russa a Kaliningrad, con l'obiettivo di disturbare "la navigazione e le telecomunicazioni nemiche".

Anche l'Autorità norvegese per l'aviazione civile, LFV, sta seguendo la vicenda.

CENSURA

La Turchia ha bloccato diverse VPN

Secondo documenti visionati dal Financial Times, un mese fa l'Autorità turca per le tecnologie dell'informazione e delle comunicazioni (Information Technologies and Communications Authority - BTK) ha intimato ai fornitori di servizi Internet di limitare l'accesso a 16 servizi di VPN, tra cui TunnelBear, Surfshark e CyberGhost.

Nel mentre, X dichiarava di aver "preso provvedimenti" contro 15 post a seguito di un'ordinanza del tribunale, e che avrebbe rischiato un ban in Turchia se non avesse rispettato l'ordine.

Il Financial Times di fatto corrobora quanto già riportato settimane prima da DW, che tra le VPN bloccate citava anche Proton, Ipvanish e Cyberghost.

Qui una lista delle 16 VPN.

MICROCHIPS/ EUROPA E ITALIA

L’industria dei microchip fa gola all’Europa e all’Italia

L’Ue e i singoli Paesi accelerano la produzione di semiconduttori. L’Italia ci prova con una fondazione e un decreto. In attesa di maxi investimenti dei privati. Ma la concorrenza è tanta.

”Intel ha annunciato investimenti per 80 miliardi di dollari spalmati su 10 anni per la produzione di chip in Europa non solo per computer ma anche per il settore automobilistico. Come ha detto Gelsinger durante il Motor Show a Monaco di Baviera di quest’anno, “le automobili stanno diventando computer con le ruote, noi abbiamo bisogno di voi e voi di noi. L’obiettivo è creare un centro di innovazione in Europa, per l’Europa”. In prima fila, secondo le indiscrezioni, ci sono la Germania (dove devono essere realizzate altre due fabbriche di microchip) e poi forse Francia e Polonia”.

Approfondimento sul nostro sito Guerredirete.it a firma di Antonio Dini.

SPYWARE

Polonia, il nuovo parlamento vuole un’inchiesta su Pegasus

Il parlamento polacco ha dichiarato di voler creare una commissione d'inchiesta sul presunto uso dello spyware Pegasus da parte del precedente governo nazionalista, guidato dal partito Diritto e Giustizia (PiS), “sospettato di aver spiato politici dell'opposizione e magistrati critici nei confronti della sua amministrazione”, scrive Euractiv. Il nuovo governo filoeuropeo, guidato dall'ex presidente del Consiglio europeo Donald Tusk, è subentrato al PiS a dicembre dopo la vittoria elettorale.

Sul tema Europa e spyware abbiamo scritto diversi articoli su Guerre di Rete. L’ultimo, uscito la scorsa settimana, è questo.

APPROFONDIMENTI

AI SAFETY

I ricercatori della startup Anthropic hanno pubblicato un paper secondo il quale il training di sicurezza per i modelli linguistici di AI che integrano comportamenti da backdoor non è sufficiente a prevenire comportamenti dannosi. Se vi chiedete cosa sia un comportamento da backdoor, il paper fa un esempio preciso: un modello addestrato per scrivere codice sicuro quando il prompt indica l'anno 2023, ma che inserisce del codice che può essere sfruttato da un attaccante quando l'anno indicato è il 2024. Questo comportamento da backdoor può essere reso persistente - scrivono i ricercatori - in modo da non venire rimosso attraverso le tecniche standard di safety training, come il fine-tuning supervisionato e altre.

Vedi anche Decoder.

AI HYPE

Se tutto diventa AI

Al Ces, la fiera della tecnologia di Las Vegas, era tutto AI, anche quello che non lo era. A dimostrazione che continuiamo a essere in cima all’onda di hype che attraversa il settore.

“Ma dato che sempre più aziende ribattezzano come AI tutto ciò che riguarda degli algoritmi, come possiamo separare il grano dal loglio? E soprattutto, questo non porterebbe a promesse eccessive su ciò che la AI è in grado di fare?”, scrive The Verge.

ESPERTI

The Expanding Universe of Generative AI

Il panel al WEF di Davos con Andrew Ng, Aidan Gomez, Daphne Koller, Yann LeCun, Kai-Fu Lee, Nick Thompson - VIDEO

EVENTI

Ci vediamo il 2 febbraio a Genova per un convegno organizzato dall’università (DITEN) e l’Europarlamento su L’approccio europeo all’intelligenza artificiale, dove interverrò insieme a Brando Benifei (corelatore dell’AI Act al Parlamento UE) e Rodolfo Zunino. Modera Lorenzo Ivaldi.

Aula Meridiana, via Balbi 5, ore 9

Ingresso gratuito da prenotare via Eventbrite

Per seguirlo online qua.

→ DIFFONDI LA NEWSLETTER

Ti è piaciuta la newsletter? Inoltrala a chi potrebbe essere interessato! Promuovila sui social. La newsletter (che è fatta nel mio tempo libero) resta gratuita, indipendente, senza sponsor, mandanti o agende altrui, e si diffonde col passaparola dei suoi stessi utenti.

Non sei ancora iscritto? Iscriviti qua, è gratuita.

—> INFO SU GUERRE DI RETE

Guerre di Rete è un progetto di informazione sul punto di convergenza e di scontro tra cybersicurezza, sorveglianza, privacy, censura online, intelligenza artificiale, diritti umani, politica e lavoro. Nato nel 2018 come newsletter settimanale, oggi conta oltre 12.000 iscritti e da marzo 2022 ha aggiunto il sito GuerreDiRete.it.

Nell’editoriale di lancio del sito avevamo scritto dell’urgenza di fare informazione su questi temi. E di farla in una maniera specifica: approfondita e di qualità, precisa tecnicamente ma comprensibile a tutti, svincolata dal ciclo delle notizie a tamburo battente, capace di connettere i puntini, di muoversi su tempi, temi, formati non scontati.

Il progetto è del tutto no profit, completamente avulso da logiche commerciali e di profitto, e costruito sul volontariato del gruppo organizzatore (qui chi siamo).

Ha anche una pagina Facebook, un profilo Twitter, Linkedin e Instagram. Seguiteli! I podcast della newsletter li trovate sulle principali piattaforme ma attualmente sono in pausa (Apple Podcasts; Spotify; Google Podcast; Anchor.fm)