ChatGPT全新功能公开演示!OpenAI总裁:ChatGPT会重新定义计算机(全文记录)

2023-4-22 12:13:36

Author: 爱范儿(查看原文)

阅读量:28

收藏

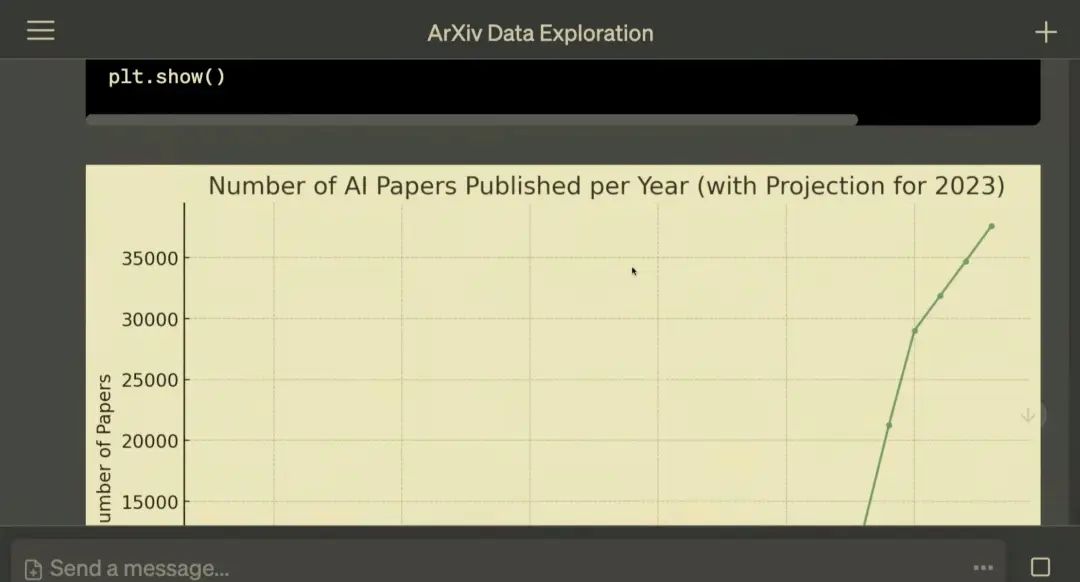

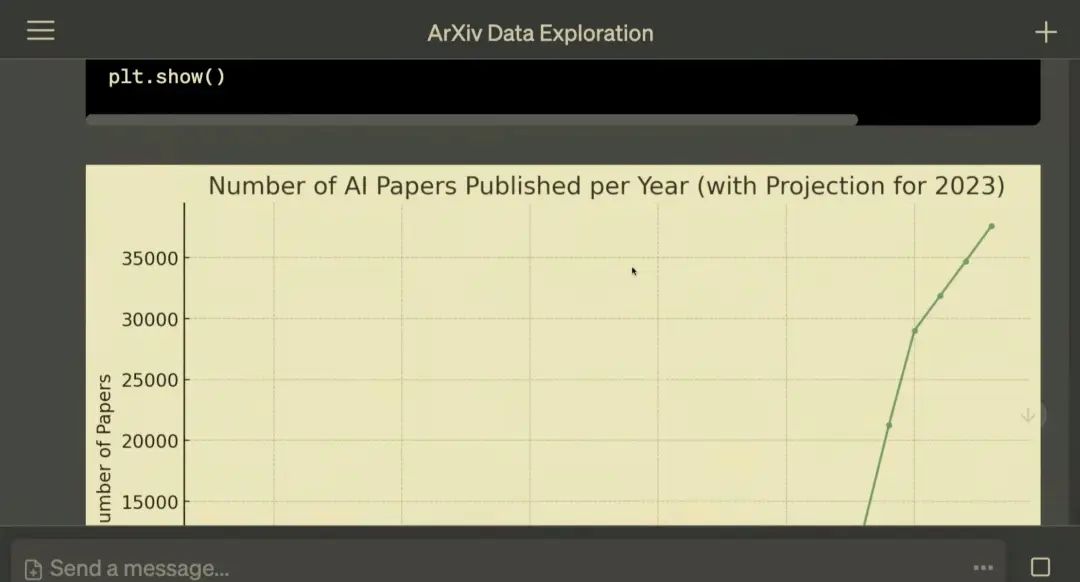

未来几个月内所有 ChatGPT 用户都能用上插件功能。建立在无数工具之上的 ChatGPT 是一种新的用户界面模式。人类与 AI 协作能解决许多看似不可能解决的问题,例如重新设计我们与计算机交互的方式。七年前,我们成立了 OpenAI,因为我们觉得人工智能领域正发生着一些非常有趣的事情,而我们希望帮助它朝着积极的方向发展。自那以后,整个领域的发展速度十分惊人。我们从使用我们的技术的开发者(比如 Raymond)那里听到了许多美妙的事情,真的很令人欣慰。我们已经听到了一些人对人工智能感到兴奋、担忧或同时感受这两种情绪的声音老实说,这也是我们自己的感觉。最重要的是,我们感到我们正在进入一个历史时期,在这个时期里,我们将会定义一项对我们社会至关重要的技术。我相信我们可以将其善加利用。今天,我想向大家展示这项技术的当前状态以及我们所坚持的一些基本设计原则。首先,我要向大家展示的是,构建人工智能工具与构建人类工具的不同之处。我们现在有一个新的 DALL-E 模型,可以将其作为 ChatGPT 的插件搭配使用。你可以这样做:给个建议,告诉我结束演讲后的晚餐吃什么,并把它画出来。你可以从 ChatGPT 的交流中得到创意和创造性的灵感,而 AI 则能为你完成剩余的所有细节。现在,ChatGPT 并不仅仅生成文本,它也生成图像(注:使用了 DALL- E 插件后)。这使得它能够更好地代替你,把你的想法变成现实。现在,让我们来看另一个 AI 工具的例子,比如存储记忆。当你说「将它保存下来以备后用」时,这个工具将会保存这个信息。这些工具在使用时都是有迹可循的,你可以清晰地了解到机器在使用哪些工具,并提供反馈。(图片生成好了)这里,我要指出的是这是一个现场演示,这一切都是由AI实时生成的,所以我实际上甚至不知道我们会看到什么。这张图看起来很不错,把我也给看饿了。让我们回到正题,我们还使用其他工具扩展了ChatGPT,例如,记忆功能。您可以说「将这个保存到以后(的使用中)」。当你在使用这些工具时,你会看到写着「使用DALL-E应用程序」的提示。顺便说一下,所有 ChatGPT 用户都会在未来几个月内都能用上这个功能。在这里你可以看到 AI 是如何像人类一样编写提示的,便于你在后续做反馈调整。现在这些信息已经被保存,让我展示一下如何使用这些信息,并与其他应用程序组合使用。你可以说:「现在为我之前建议的美食制作一个购物清单,还要发布在 Twitter 上。」你可以看到,ChatGPT 会选择合适的插件,而无需我的指引。我认为这是一种新的用户界面模式。过去我们总是习惯于思考该怎么在不同的应用程序之间切换、复制/粘贴,并且通常只有在你对这些应用很熟悉的情况下,才能获得一个很好的使用体验。现在我们通过一个建立在无数工具之上的统一语言界面,就可以完成这些工作。ChatGPT 为我们生成了一个 Instacart 的购物清单,里面包含了我们需要的购买的材料,非常方便。需要说明的是,传统的用户界面仍然非常有价值。通过传统用户界面,我们可以快速地修改实际数量(等操作)。这表明传统的用户界面并没有因此而消失,只是现在我们有了一种新的、更高效的方式来构建它们。现在,我们已经起草了一条推文,供我们审阅。这也是非常重要的一点。我们可以根据自己的意愿,去调整人工智能的工作。现在,让我们回到主题上。我们打造 ChatGPT 的关键,不仅仅在于创建这些工具,还在于教导 AI 如何使用它们。当我们提出一些高难度的问题时,我们要求它做些什么呢?为此,我们采用了一个古老的想法——阿兰·图灵 1950 年论文中提到的图灵测试。他说,你不可能用程序来为这个测试生成一个答案,相反,你可以教它。就像教一个小孩子一样,我们可以建立一个机器,并提供奖励和惩罚来教导它尝试一些事情,不论是好的还是坏的。这正是我们训练ChatGPT的方法。我们将其分为两个步骤。首先,我们通过无监督学习的过程生成一个所谓的「机器孩子」,就像图灵所说的一样。我们向这个「小孩」输入整个世界、互联网的数据,然后让它根据提供的文本预测下一个词。这个过程赋予了它各种技能,例如可以看懂数学题并通过推理得出答案。但要掌握这些技能还需要进行第二步,即教导 AI 如何使用这些技能。为此,我们要给 AI 提供反馈。我们让 AI 用多种方法为我们提供不同的建议,然后再由人类评分,选出最合理的答案。这样不仅可以强化 AI 的具体表达,还可以强化产生答案的整个过程。这使得 AI 能够概括、教授并推断人类的意图,还能将其应用于它之前没有见过或没有收到过反馈的情况。但有时我们需要教授 AI 的东西并不是我们期望的。例如,当我向可汗学院展示 GPT-4 时,他们认为它很棒,可以用来给学生做辅导。他们发现 GPT-4 不会纠正学生的数学错误,如果在对话中出现错误,它会假装 1 加 1 等于 3 并继续运行。因此,我们需要收集更多的反馈数据,教授 AI 要在特定情况下反驳人类。当在 ChatGPT 中点下 👎 按钮时,就会给我们发送一个信号告诉我们需要收集这段反馈。这是我们听取用户意见的方式,确保我们正在构建对每个人更有用的东西。提供高质量的反馈是一件困难的事情,但是 AI 本身愿意提供帮助。它愿意帮助我们提供更好的反馈,并随着时间的推移扩大我们监督机器的能力。举个例子。你可以向 GPT-4 提个问题,然后它会给你回答两个月。要知道,大模型回答的答案往往并不可靠,我们怎么确保它的答案是正确的呢?通常情况下,我们需要自己上网再次搜索相关的问题,对照检查答案。这非常枯燥、繁琐、费时。现在我们可以把这些重复性工作丢给 AI。利用浏览工具,我们可以 AI 自己来核实事实。我们把刚才的问题和回答输入进去,然后让它重新核实事实,它就会自己写下它的思考链,一步步地搜索所需内容、对应检查答案。结果证明,GPT-4 果然回答错了,正确答案是两个月又一个星期。这是它自己检查出来的正确结果。这个过程非常有趣,因为它需要人类与人工智能多步合作:人类使用事实核查工具是为了为另一个人工智能生成数据,从而使其能更好地为人类服务。我认为这种合作模式在未来会变得非常普遍,即我们需要人类和机器协作来解决问题,确保人类以一种可视化和值得信赖的方式管理、监督和反馈机器。在这两种力量的共同努力下,我们可以建立更加可靠的机器。我相信,随着时间的推移,如果我们成功地把这个过程进行下去,我们将能够解决一些看似不可能解决的问题——例如我们能够重新设计我们与计算机交互的方式。我相信,随着时间的推移,如果我们成功地进行这个过程,我们将能够解决一些看似不可能的问题。为了让你更好地理解我所说的“不可能”的难度,我认为我们将能够重新思考我们与计算机交互的几乎每一个方面。自从40年前出现了 VisiCalc 以来,电子表格就一直以某种形式存在。但是,在这段时间里,它们的变化并不是很大。这里有一个关于过去 30 年 arXiv 上的所有 AI 论文的电子表格。大约有 167000 篇。让我向你展示 ChatGPT 如何分析这个数据集。我们可以让 ChatGPT 使用 Python 解释器作为工具,这样它就能像数据科学家一样运行代码。你可以直接上传一个文件并提出问题。需要强调的是,这是一个超级高层次的指令,里面带有大量的意图,我甚至不知道我想要的是什么。因此,AI 必须推断出我可能感兴趣的内容。它给出了一些不错的想法,例如对论文作者数量的每篇文章的直方图、每年论文数量的时间序列、论文标题的词云。我认为所有这些都很有趣。很棒的是,它确实可以画出来。然后它会根据每年的论文数量制作一张图表。然而,我们可以看到在 2023 年发生了一些奇怪的事情,看起来我们一直处于指数增长,然后就发生了坠崖式的跌落。顺便说一下,所有这些都是 Python 代码,你可以随便检阅生成的过程。这里的问题很简单,因为我们今年还没有结束,因此从数据来看 2023 才会这么糟糕。让我们继续输入我们的反馈,让他统计根据 2022 年 4 月 13 日前发布的文章数量占据 2022 年全年文章总量的百分比,公平地预测 2023 年全年的论文数量。也许这对它来说有点过分,因为它本已经神奇地推断出这是我想要的图标。但我为我的意图提供了这个额外的指引。在幕后,AI 又写了一遍代码,所以如果你想要检查它在做什么都可以看到。如果你注意到的话,它甚至更新了标题。我没有要求这一点,但它知道我想要什么。现在我们回到幻灯片上。这张幻灯片展示了我对我们未来如何使用这项技术的愿景。在这个故事中,一个人带着他病得很重的狗去看兽医,但兽医做出了错误的诊断,说:「让我们再观察一下。」如果主人照做了,这只狗可能就没能活下来。但他没有。他将狗狗的血液测试和完整的医疗记录输入给了 ChatGPT,ChatGPT 回复说:「我不是兽医,你需要找专业人士咨询,但我可以你一些假设。」带着这些信息,他找到了第二个兽医,后者成功地挽救了狗的生命。我想表达的是,尽管我们现在的系统并不完美,但如果一个人与 ChatGPT 作为头脑风暴伙伴合作,或许就能取得非同凡响的结果。我认为这是我们考虑如何将 AI 整合到我们的世界中时,需要反思和思考的事情。我深信,让 AI 正确运作需要每个人的参与。我们要共同地决定如何将 AI 整合进我们的生活,为它制定规则,确定 AI 将能够和不能够做什么。AI 的发展已经超出了人们的预期,因此,我们每个人都必须得熟练掌握它,这也是我们发布 ChatGPT 的原因之一。我相信,我们能够实现 OpenAI 的使命,确保人工通用智能造福人类。CA:主持人 Chris Anderson:

GB:Greg BrockmanCA:哇,我注意到在场的每个人的内心都有些许颤抖。我想,很多人看到这里时,会觉得自己的工作每个环节都需要重新考虑。这太惊人了,但也太可怕了。那么,让我们谈谈吧。我的第一个问题就是,你们究竟能如何做到这一点?OpenAI 只有大约几百名员工,Google有数千名员工从事人工智能领域的研究。为什么是 OpenAI 开发了这个震惊世界的技术呢?GB:实际上,我们都是站在巨人的肩膀上进行研究的,这是毫无疑问的。如果你关注计算机进展、算法进展或数据进展,那么这些都是整个行业的进展。但我认为,我们在 OpenAI 内部从早期就做出了许多深思熟虑的选择。第一个决定是直面现实。我们深思熟虑,思考实现进展需要什么。我们做过许多失败的尝试,所以你只看到了我们成功的地方。我认为最重要的一点是让团队中不同的人和谐地合作。CA:你是否认为你们在语言模型中看到的东西意味着,如果继续投资和壮大它们,某些时刻可能会出现某些新的东西呢?GB:是的。而且,我认为这非常有启示性。高层的深度学习一直是我们想做的事,这是一个深度学习实验室,但具体该如何做呢?早期我们不知道该怎么做。我们尝试了许多事情,其中一个人正在训练一个模型,预测亚马逊评论中的下一个字符,这听起来就像是一个句法分析的过程,但他没想到的是这其实一个最先进的情感分析分类器。这个模型可以告诉你评论是积极的还是消极的。今天,我们会觉得这很容易,任何人都可以做到。但当你第一次看到这种从底层句法过程中出现的语义,我们知道,我们必须要扩展这个模型,看看它会走到哪里。CA:ChatGPT 被描述为预测机器,然而我们所看到的却感觉不太可能是通过预测得出的。有没有一刻,让你看到的事情出乎意料,震惊到了你的内心?请给我分享一下这个瞬间。GB:是的,你可以在 ChatGPT 中尝试做 40 位数之间的加法,这个模型将会计算出它们的和,这意味着它确实学会了一个内部的法则来解决这个问题。而真正有趣的是,如果你让它计算一个 40 位数加上 35 位数的和,它经常会出错。这表明它确实在学习这个过程,但它还没有完全泛化,对吗?就像你不能记住 40 位加法表一样,那比宇宙中的原子还要多。所以它必须学会了一些普遍的方法,但它还没有完全学会:噢,我可以将这个方法推广到处理任意长度的任意数值加法。CA:所以这里发生的是你让它扩大并查看大量的文本。它正在学习一些你不知道它能够学习的东西。GB:是的,而且它也更加细腻。所以我们开始真正擅长的一门科学是预测其中一些新出现的功能。而要做到这一点,我认为这个领域中一个非常被低估的事情是工程质量。就像你构建火箭时,每个公差都必须非常小一样,在机器学习中同样如此。你必须将整个堆栈的每个部分都正确地编好,然后才能开始进行这些预测。这里有许多非常平滑的缩放曲线,它们向我们展示了智能的本质。如果你查看我们的 GPT-4 博客文章,你可以看到这些曲线。现在我们开始能够进行预测了。例如,我们能够预测编码问题的表现。我们基本上观察一些模型,这些模型要小 1000 倍或者 10000 倍。这其实是缩放曲线的一步,尽管现在还在早期阶段。CA: 在这里,一个大的担忧就是,随着规模的扩大,有些东西可能是可以被预测的,但是有时又会出现令人惊讶的情况。谁能保证这里不会有巨大的风险导致某些非常可怕的事情发生呢?GB: 我认为这些都是程度和规模以及时间的问题。此外,人们还会忽略与世界的融合,这也是一件极为突出的紧急事件。这就是我们认为逐步部署的重要原因之一。因此,我认为目前我们所看到的,如果你看看这次演讲,大部分的注意力都集中在提供高质量的反馈上。今天我们所做的任务,可以进行检查。比如说,很容易看出这道数学问题的正确答案是七而不是八。但就连书籍的摘要,也是一个很难监督的事情。你怎么知道这个书摘是好的呢?你必须读整本书。没人想这么做。因此,我认为重要的是我们要一步一步地做。当我们进入到书摘阶段时,我们必须妥善监督这个任务。我们必须建立起机器能够真正执行我们的意图的记录。我认为我们将不得不制定出更好、更高效、更可靠的方法来扩展这个技术,使机器与你保持一致。CA: 随后我们将会听到有批评者说,你知道,系统内部没有真正的理解力,它总是会产生错误它没有常识等等。你相信它任何时刻都会是这样吗?你刚才谈到的规模的扩大和人类的反馈,基本上会带它走向真理和智慧等目标,你有信心吗?GB: 是的,我相信 OpenAI,我的短期答案是「yes」。我认为 OpenAI 的方法一直都是尽可能地接触现实。这个领域是充满了破灭的承诺,所有这些专家都在说这样或者那样,事实并非如此。人们已经说了 70 年内神经网络都行不通。但他们不一定对。也许还需要再过 70 年加一年这样子。但我认为我们的方法一直都是要推动这个技术的极限,从而真正看到实际效果,因为这会告诉你,噢,这就是我们如何过渡到一个新的范式。我们还没有挖尽这个领域的潜力。CA:你所持有的立场相当具有争议性,认为公开发布并利用这一切(而不是只让你的团队提供反馈),让全世界都提供反馈是做好这件事的正确途径。但是……如果会出现不好的事情,当然这已经有不少。我听说过 OpenAI 在成为非营利组织时的最初目的,是要作为一个伟大的审核员,对于那些可能使用 AI 开展未知、可能恶意的行为的大公司进行调查。你将建立一种模型,以某种方式使它们对其负责,并且在需要时能够减缓进展。或者至少我听说是这样的。然而,所发生的情况与此相反。你们发布的 GPT 尤其是 ChatGPT,在技术界引起了巨大的震动,以至于 Google、Meta等公司现在都在疯狂赶超你们。他们的一些批评是,你们迫使他们在没有适当防护的情况下发布这些内容,否则就会失败。你们如何证明自己的做法是对社会负责而不是鲁莽的呢?严格意义上来说,我们始终不可能做得完全正确。但是,有一件事我认为至关重要,即从一开始思考如何构建通用人工智能,使其有益于整个人类的角度出发,你该怎么做呢?你会选择保持秘密,然后获得这个极其强大的东西,接着就能将其安全使用,或者你就这样去执行计划,希望一切都能成功。我不知道怎样执行这个计划,或许其他人知道。但对于我来说,这个计划让人感到恐惧,并不合适。因此,我认为这个替代方案是我所看到的唯一条路线,即直面现实。我认为,在这些机器变得完美、超级强大之前,给人们时间提供反馈、观察它们实际行动是非常重要的。我们从 GPT-3 看到了这一点。当时,我们真的担心,人们使用它的主要目的是生成错误信息、尝试干预选举。而它实际上被用来生成销售伟哥的垃圾邮件,这成为了它最主要的用途。CA:所以说,垃圾邮件是很糟糕的,但有些事情比它还糟糕。让我来谈个思维实验。假设你坐在一个房间里,桌子上有一个盒子。你相信在那个盒子里装着一些东西,其中有很大的可能性是来美好的东西。但有百分之一的可能会释放出世界无法想象的邪恶。你会打开这个盒子吗?GB:那么,当然不。我认为你不能那么做。老实说,我会告诉你一个以前从未讲过的故事,就是在我们成立 OpenAI 不久之后,我记得我在波多黎各参加了一次 AI 会议。我坐在酒店房间里望着这美好的水,所有人都玩得很愉快。你会想一想,如果你可以选择让潘多拉的盒子在 5 年后或 500 年后打开,你会选择哪个,对吧?一方面,你也许会认为对你个人来说,5 年后更好一些。但如果能等到 500 年后,人们可以有更多时间做对它,你会选择哪个呢?我当时真的很感受到这一点。我觉得当然是 500 年。所以,我真的很明白你必须把它正确地应对。但我认为这并不是实际情况。如果你看看计算机的整个历史,这是一次行业甚至是作为技术发展的人类历史上的转变。你越是不把它们放在一起,就意味着你会留下一个负担,也就是说,如果有人或某一时刻有人设法连接到电路上,那么你就会突然拥有这个非常强大的东西,没有人有任何时间去调整,也不知道会有什么样的安全措施。所以,我的一个观点是,即使是其他技术的开发,例如核武器,人们谈论它是一个人类社会从 0 到 1 的变化。但我实际上认为,它的研发在时间上一直非常平稳。CA:我的理解是,我们拥有的模型可以视为我们已经孕育了这个非凡的孩子,这个孩子可能拥有超能力,让人类走向一个全新的世界。这是我们共同的责任,为这个孩子提供护栏,共同教导它成为明智的人,而不是摧毁我们所有人。对吗GB:是的。我认为非常重要的是,我们要学会理解这项技术,找出如何提供反馈,决定我们想从中得到什么。我希望这会是正确的路径。

文章来源: http://mp.weixin.qq.com/s?__biz=MjgzMTAwODI0MA==&mid=2652254763&idx=1&sn=909d2c08a51f1bd0deaf30b2c48d6c11&chksm=9b60a4b4ac172da2c889da4cc5e500b497d26daf19cda158dcb5f15b74764f44c98f69858093#rd

如有侵权请联系:admin#unsafe.sh