2023年4月8日~9日,由InForSec、南方科技大学斯发基斯可信自主系统研究院、清华大学网络科学与网络空间研究院、复旦大学软件学院系统软件与安全实验室、国科学院计算技术研究所处理器芯片全国重点实验室、中国科学院软件研究所可信计算与信息保障实验室、中国科学院大学国家计算机网络入侵防范中心、浙江大学NESA Lab、山东大学网络空间安全学院、百度安全、奇安信集团、蚂蚁集团、阿里安全等单位联合主办的“InForSec 2023年网络空间安全国际学术研究成果分享及青年学者论坛”在南方科技大学成功召开。来自清华大学、复旦大学、浙江大学、北京邮电大学、中国科学院大学等66所高校及科研院所的230余人现场出席会议,900余人通过视频会议系统及直播系统参与了本次论坛。

我们将对会议精彩报告进行内容回顾,本文分享的是复旦大学潘旭东博士的报告——《基于神经元状态的深度学习系统私有数据重建攻击》。

潘旭东博士来自于复旦大学系统软件与安全实验室 (https://secsys.fudan.edu.cn/)的白泽智能团队 (Whizard AI),负责人为张谧教授(访问主页请点击文末阅读原文)。该团队主要研究方向为为智能系统安全,机器学习/深度学习模型安全,包括:图像、文本、时间序列、推荐、社交网络、知识图谱、自动驾驶系统、分布式系统、移动智能终端等应用,在网络安全和AI领域国际顶会顶刊已发表论文30余篇。

首先,潘博士对开放网络环境下的AI系统所面临的诸多安全风险进行了总结。潘博士指出,随着AI技术的发展,AI产业涌现多种更加开放的新生态,例如开放式学习、机器学习在线服务、第三方模型托管仓库等。目前开放网络环境下的AI系统全生命周期正依赖于多种安全主体,例如服务商、模型提供商、用户等,进而导致目前的AI系统存在数据隐私风险、AI产权保护、AI供应链安全风险等问题。

针对这些安全风险,潘博士简要报告了复旦大学白泽智能团队围绕这些安全问题做出的最新研究成果。在AI供应链攻防方面,针对AI产业生态中普遍存在的预训练模型和外包标注数据现象,白泽智能团队提出的基于文本风格的NLP隐式后门攻击,适用于GPT-2、BERT等大语言模型,可以绕过各类主流后门检测方案 (USENIX Security'22)。

在AI产权保护领域,潘博介绍了团队提出的基于神经元不变性的模型版权破坏方法,能同时攻破9种模型白盒水印方案 (USENIX Security'23),以及通用模型指纹追溯技术,可以实现远超现有技术的盗版追溯能力 (KDD'22)。基于这些研究,白泽智能团队形成了首个聚焦可验证、可追溯、可反制的深度学习模型产权保护平台,作为作为全国征集的7个AI安全典型实践案例之一,收录于2022版《人工智能安全标准化白皮书》。

在AI模型数据隐私方面,潘博士介绍了团队在2022年的两项研究成果,第一个是其提出的基于模型隐写的私有数据窃取方案,首次实现220 × 载体大小的私有数据隐秘传输,同时隐藏多个异构数据集(NeurIPS'22);第二个是基于神经元激活状态分析的私有训练数据重建攻击,首次支持上百张训练样本的同时破解,精度超越现有最好的算法400% (USENIX Security'22)。

接下来,潘博士对团队提出的基于训练梯度的数据重建攻击展开进行了详细介绍。首先潘博介绍了何为基于梯度的数据重建攻击,即利用分布式训练过程中产生的模型平均梯度重建训练数据。

潘博指出传统的工作通常以经验式的方法进行攻击,但是他们并不满足于经验式的攻击,因为这种攻击方法很难去评估其可行性。因此,团队尝试去解答为什么这些经验式的攻击方法是可行的,以及是否有更好的解决方案。

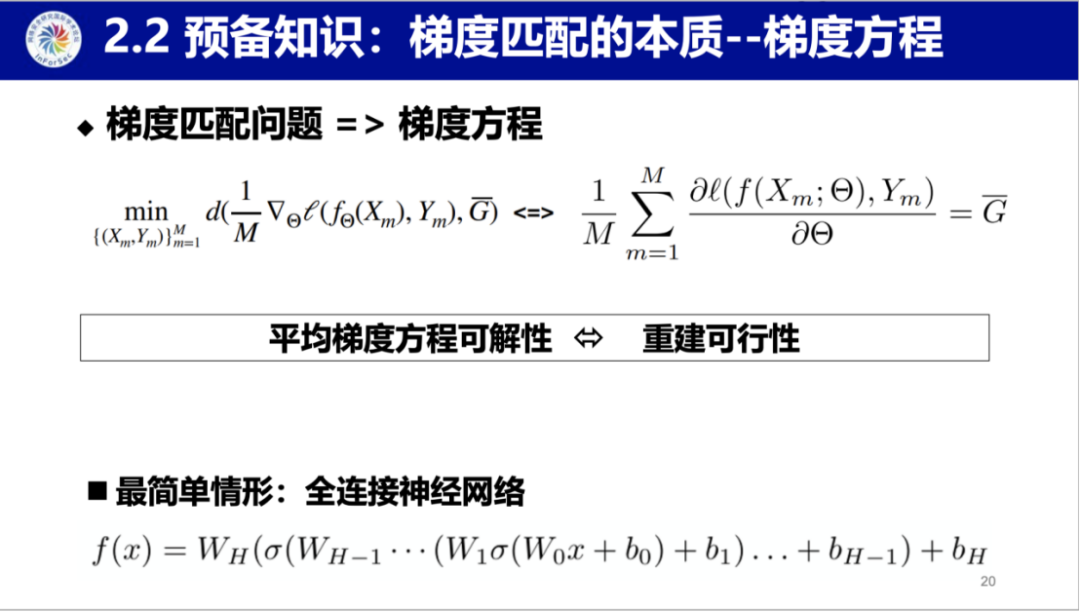

潘博先向大家介绍了现有攻击方法的本质。潘博认为现有的数据重建攻击都是通过求解“梯度匹配问题”重建样本,而该梯度匹配问题本质上可以转换为一个梯度方程,那么梯度匹配问题的求解问题就转换为了梯度方程可解问题,从而将抽象的攻击可行性问题转换为了具象的梯度方程可解性问题。

随后潘博介绍了神经元激活状态与排他性神经元概念,并指出排他性神经元个数代表了神经网络内部残留的可分离性,可以用于评估数据重建攻击的可行性,基于此发现,团队分别从攻击侧和防御侧进行了研究。

在攻击侧,潘博进一步介绍了其所提出的数据重建攻击算法。

在防御侧,潘博则提出了相应的排他性消除策略。

此外,潘博还介绍了团队所进行的探索性研究,包括是什么影响了训练批次满足神经元排他性,以及排他性真的影响重建效果吗。

最后,潘博将上述攻防两侧的研究成果转化为数据重建攻击在神经元激活状态层面的安全边界问题,并探讨了未来研究方向。

演讲者简介

潘旭东,复旦大学系统软件与安全实验室五年级直博生,师从杨珉教授、张谧教授(访问主页请点击下方阅读原文)。研究兴趣主要覆盖AI模型数据隐私、AI模型产权保护和AI供应链安全。博士期间已有24项研究成果发表在包括S&P、USENIX Security(5篇一作)、TPAMI、ICML、NeurIPS等网络安全及人工智能领域顶级会议期刊。成果曾获WAIC青年优秀论文提名奖,并作为全国征集的7个人工智能安全典型实践案例之一入选《人工智能安全标准化白皮书》。

如有侵权请联系:admin#unsafe.sh