cckuailong

读完需要

速读仅需 3 分钟

原文链接:https://zhengdongwang.com/2023/06/27/why-transformative-ai-is-really-really-hard-to-achieve.html

1

这边的「AI 变革」指的是当 AI 技术发展后,对整个社会、经济、文化产生了颠覆性的影响。

文章分 3 个重点:

变革,受限于最困难的技术上

技术本身只是变革的一个因素,还需要社会制度、规范、重组等因素配合

不应该过度投注某一领域,而是各个领域的创新都要关注

2

作者对于 AI 变革提出一个更具体的定义:

「一个在所有具有经济价值的任务上,能够达成或超越人类水平的系统」

作者用一个更具体的目标说明,那就是强大的 AI 有朝一日可以执行所有生产力相关的思考与物理劳动。

而且透过模型预测,每年的 GDP 成长至少会大于 3%。

但泼冷水的时候到了,社会发展就像一个木桶能装多少水一样,取决于最短的那个板子,也就是经济学家 William Baumol 在 1960 年代首次指出的那样,不平衡的生产力成长可能受到最弱行业的限制。

内文提到一个非常直白的例子就是,就算提高了 100 倍的写作效率,可能也只会让经济成长 2 倍。

劳动密集型产业(例如医疗、建筑等)的生产力无法大幅改变,才是整体社会总体经济缓慢的原因,也就是刚刚说的木桶短板影响经济。

但是部分行业生产力提升,带动薪资的上涨,却会影响这些劳动密集型产业的薪资及成本,这边引出了另一个效应,叫做鲍莫尔现象(Baumol effect )。

简单来说,鲍莫尔现象就是在描述即使某些行业的生产力没有显著增加,但是由于其他行业工资的上升(因为生产力上升),导致它们的工资和成本也必须增加的现象。

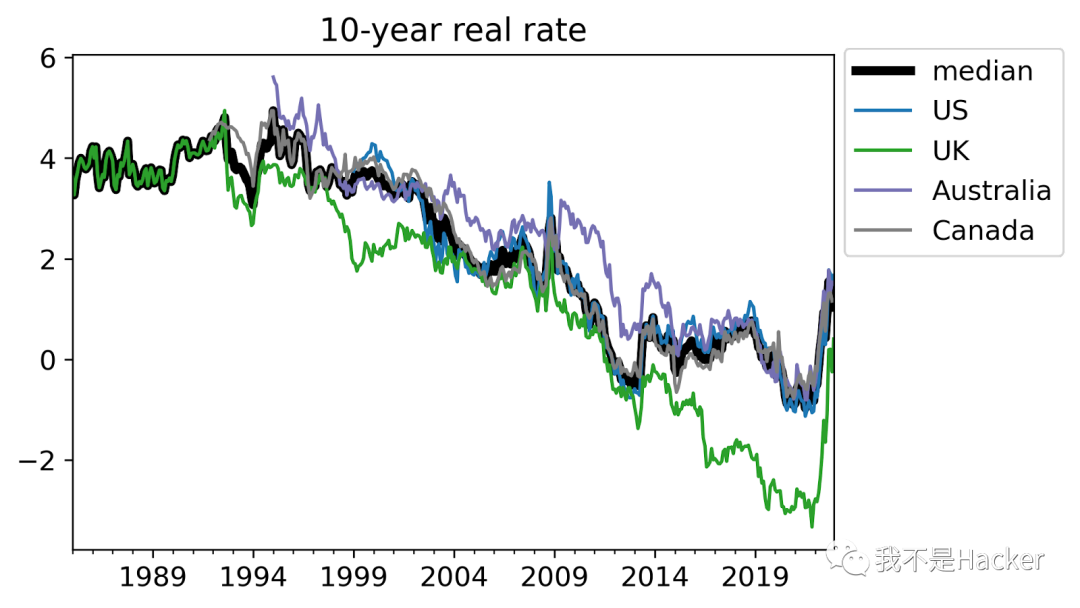

还有个专门的图如下:

3

纵使 AI 的某些领域看似快速发展,但仍然存在重大的技术障碍。

虽然现在语言模型进步的程度一度让人觉得 AI 是不是有意识了,但是你知道吗,要机器人系好鞋带都是一件非常困难的事情。

在 AI 这个领域,一直有一件很吊诡的事,那就是『困难的问题很容易,而容易的问题却很困难』。

这说明我们不能过度乐观地认为 AI 一定可以自动化所有任务,AI 领域中容易和困难的问题可能与直觉相反,我们不能假设所有问题都可以被轻松解决。

如果社会经济要有极大幅度的成长,实体机器人操控这个领域一定要有足够的进展。

而这仅仅只是其中一个技术障碍,文中还有提到其它的技术障碍。

而且,目前解决上述技术障碍的方法并不足够用,硬体设备也将达到极限,要把计算能力再往上扩大一个数量级,就必须再花费数千亿美元。

训练资料这块,Villalobos 等人也警告说,高品质的语言资料可能在 2026 年用尽。该团队提出了资料效率和合成资料作为解决办法,但到目前为止,这些解决方案都还远远不够完善。

SemiAnalysis 在《AI 砖墙——对于扩大密集 Transformer 模型的实际限制,以及 GPT 4 如何突破》提到,每增加一个量级的参数,需要付出的成本。

另一方面,对齐问题也是一大头痛点,白话文来说就是『人类限制自己』。

光是要统一人类共同的价值观就是一件非常困难的事,所以在对齐问题解决之前,人类都不可能被完全取代,因为长期看来,最佳的 AI 技术仍是专家参与并提供主张人类的价值观资料。

再来则是隐性知识。你会骑机车,但你知道机车的运作原理吗?

人类知识很大一部分是隐性、未被记录且分散的。很多时候我们在做判断依赖的是多年经验累积的直觉及感觉,这些直觉性的知识很可能是无法衡量的因素。

正因为隐性知识如此重要,所以需要让 AI 在现实世界中来实践学习!

补充说明:

AGI(通用人工智慧)在过去其实就是用 AI 来称呼,但是 AI 这个词逐渐被用来描述各种没有关联的电脑程式,像是搜寻引擎、聊天机器人等。

为了重新能提到真正的人工智慧,人们在「AI」中加了一个「G」(General,通用的)成为「AGI」。

但现在看来,AGI 反而只是暗示着一种更聪明的聊天机器人而已。

4

即使技术上的 AI 持续进展,社会和经济上的障碍仍可能会限制其影响力。

历史上,经济转型几乎是一个偶然性的过程。许多因素必须同时出现,而不是一个因素压倒其他一切。

单一的技术,无论其多么先进,只有在制度允许其被采纳、鼓励其广泛应用,并允许社会大规模地围绕新技术进行重组时,才真正具有意义。

换句话说,技术本身不足以带来变革。它需要得到相应的制度和社会支持,才能真正发挥其潜力和带来影响。例如,电动车技术再先进,如果没有政府的政策支持和公众的接受,它就难以在市场上得到广泛的应用。

所以,AI 可能无法准确自动化最需要被自动化的领域。

Callum Williams 提供了具体直观的例子:

尽管有技术可以部分或完全替代,但伦敦地铁的司机的薪水仍接近国家中位数的两倍。

政府机构一次又一次地要求你填写纸质表格来提供个人信息。

在 AI 技术发展的全球中心——旧金山,高峰时段仍然有真人警察来指挥交通。

马克·安德里森(美国最著名的科技投资人,乐观看待科技发展)说道:

『我什至认为标准的论点都不需要...人工智慧已经在大部分经济领域是非法的,而且将在几乎所有经济领域都是非法的。』

当然这个非法并非违反法律的意思,而是类似上图这个伦敦火车司机自动化受到的社会或经济因素影响。

只要违反了社会风俗或政治走向,即”非法”。

虽然 AI 技术很厉害,但在很多行业里,因为有一堆法律和规定,所以 AI 没办法随便用。

像是在医疗、开车或银行业,因为涉及到人的安全和隐私,所以政府会特别小心,不让新技术随便上路。

另一方面来看,OpenAI 的经济学家估计,大约有「19%的工作中至少有 50%的任务会受到 GPT-4 及其可能建立的各种应用的影响」。

但我们可以从另一个角度来看这个问题。

这是不是意味着超过 80% 的工人只有不到 50%的任务会受到影响呢?这距离完全自动化还有非常大的距离。

而且他们的研究方法还显示,在那些需要高度可靠性的领域,这些任务在一段时间内仍然不会受到影响。

简单来说,尽管 GPT-4 具有很大的潜力,但大多数工人的工作任务仍然不会受到太大的影响,尤其是在那些需要高度可靠性的领域。

现代经济中,很多产品和服务都具有强烈的社会和文化属性,它们不只是满足我们的基本需求,还与我们的情感、价值观和社会互动深深相连。

所以即使 AI 可以自动化全部生产,人类仍然必须积极参与商业、政治和社会,以确定人们希望社会走向何方。

人类在社会协作和决策中的作用仍旧不可或缺,AI 并无法独立决定社会的发展方向。

5

仍然对 AI 保持希望,毕竟它还是有非常大的潜力

正如本文概述的,要实现广泛的经济变革影响,有许多困难障碍。这些障碍需要视为整体一起考虑,只解决其中的一些问题可能不够。

即使我们开发出高度智能的机器,也远远不足以实现整个研发甚至整个经济的自动化。要建立能解决其他一切问题的智能,可能需要先解决那些其他一切问题。

AI 最明显的风险可能是本身强大技术的风险。AI 如果成为一个自主、不受控制和难以理解的存在,在经济变革实现将会更困难。请记得,AI 最迫切的风险是那些已经存在或在不久的将来可能发生的问题,如偏见和误用。

不要过度依赖某一领域的进步,应广泛关注各领域的创新和社会难题

本文由知识仓鼠深度阅读后,重新撰写并以白话的形式呈现,去除过于复杂繁琐难懂的资讯,并加入语言模型辅助说明部分知识。

如有侵权请联系:admin#unsafe.sh